Как мы проводим A/B-тестирование мобильных приложений

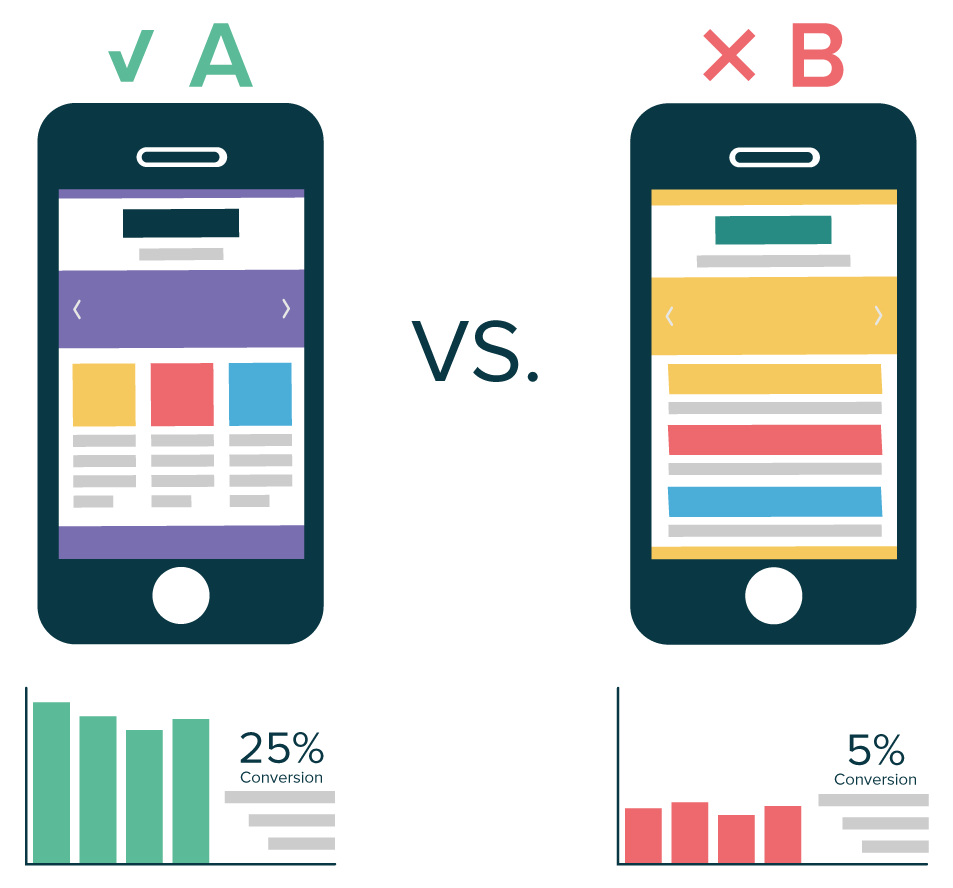

A/B-тестирование — это способ измерить эффективность продукта с помощью сравнения двух вариантов одной и той же функциональности. Метод используют в маркетинговых целях, чтобы определить, какой вид фичи принесет больше конверсии.

В этой статье мы разберем, какие задачи решает A/B-тестирование мобильных приложений, как его проводить и почему это эффективный способ исследования пользовательского поведения.

Зачем проводить A/B-тестирование?

В App Store находятся 2 миллиона, а в Google Play — 2,8 миллиона мобильных приложений. По подсчетам аналитической компании App Annie, за последний год пользователи стали загружать на треть больше программ. И чтобы юзер не удалил приложение сразу после открытия, оно должно быть удобным, качественным и простым.

Рост конкуренции заставляет делать интерфейс понятнее, а функциональность обширнее. Но загрузка каждого нового релиза занимает от нескольких часов до пяти суток, и если новая фича не понравится пользователям, разработчики узнают это с опозданием. A/B-тестирование позволяет оптимизировать процесс.

Мы проводим эксперимент, загружая несколько вариантов одной функциональности, и к моменту следующей публикации знаем, какой вариант наиболее востребован.

Выбор и варианты фич для эксперимента

Выбор и варианты фич для эксперимента

В мобильном приложении можно тестировать кнопки, заголовки, изображения, иконки. Важно выбрать только одну функциональность и представить ее в нескольких вариантах (не обязательно в двух).

А вот сама фича должна быть одна, иначе вы не сможете отследить, что именно привлекло пользователей.

Шаги A/B-тестирования

Перед тестом важно понять, какой результат мы ожидаем. Руководители и маркетологи смотрят на статистику приложения, находят болевые точки, формируют гипотезу, а тестировщики проверяют ее.

Пример

В сервисе объявлений пользователям за фиксированную цену был доступен вариант размещения «Выше остальных» . Когда топ-объявлений стало слишком много, более ранние спускались вниз. Решили ввести систему торгов, чтобы помимо фиксированной цены пользователи могли доплатить еще и оставаться на высокой позиции дольше. Для проверки гипотезы провели A/B-тест на 50% пользователей. Он оказался удачным, и эксперимент масштабировали на остальную половину.

0. Создание объектов тестирования. Берем фичу А, копируем ее и меняем один параметр — например, цвет кнопки, текст, иконку. Так получается фича В.

0. Создание объектов тестирования. Берем фичу А, копируем ее и меняем один параметр — например, цвет кнопки, текст, иконку. Так получается фича В.

-

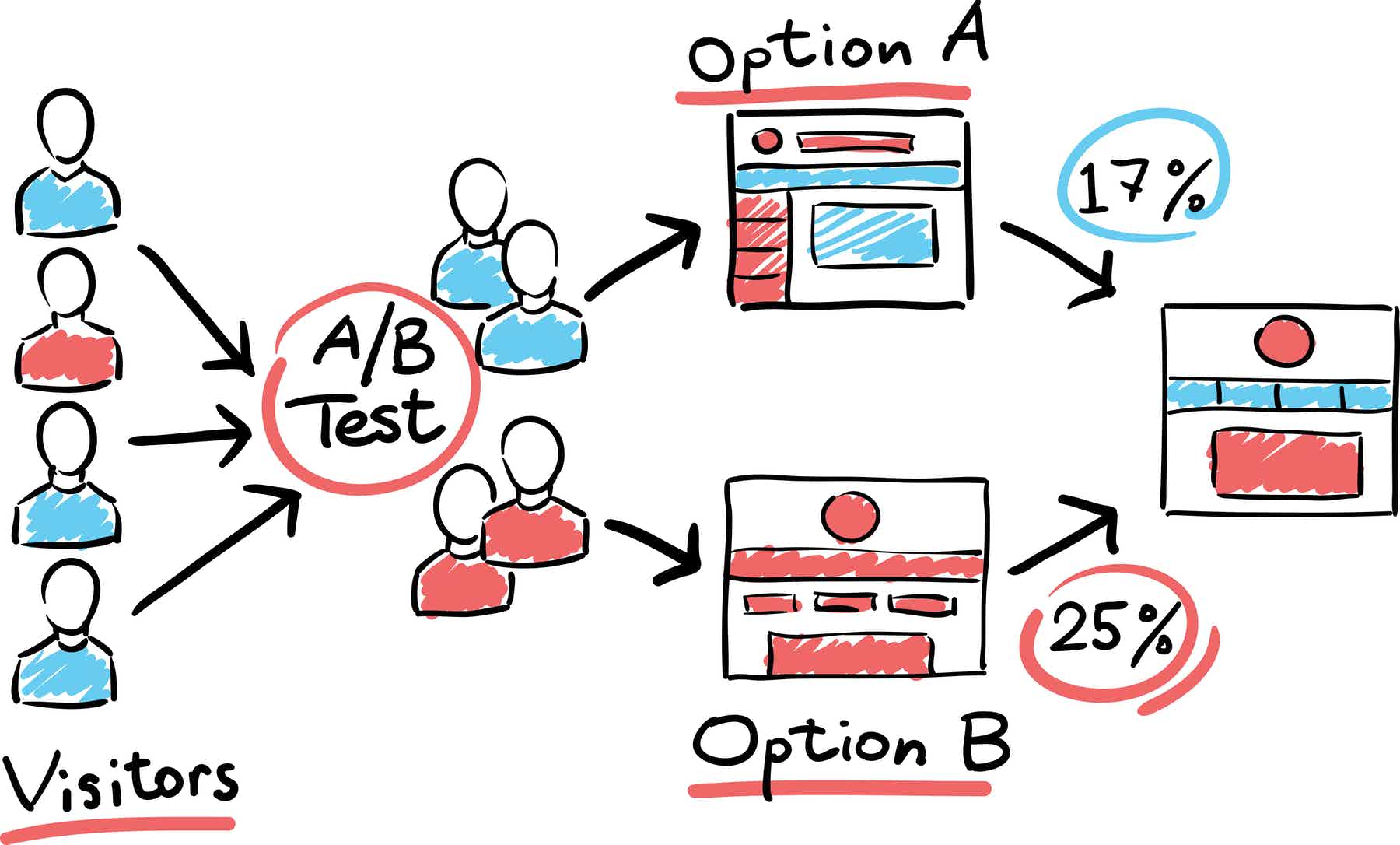

Выборка. Анализируем, какая доля пользователей должна пройти через экспериментальные фичи, чтобы результаты имели статистическую значимость. Например, вариант А должны увидеть 70% пользователей, а вариант B — 30%. Распределение долей может быть любым, это зависит от масштабов бизнеса, числа юзеров, длительности работы фичи, ваших целей. На одном проекте мы придумали новую вариацию функции, которая уже работала какое-то время. 90% пользователей видели прежний вариант, а для 10% показали новый.

-

Определение показателей. Рассчитываем, через какое время и при каких результатах эксперимент будет считаться проведенным. Например, если за две недели хотя бы один из вариантов наберет n кликов по кнопке “m”. Целью также могут быть заказы, покупки или подписки.

-

Настройка и проверка. Настраиваем аналитику в приложении, чаще всего с помощью Google Analytics. Проверяем, отображаются ли нужные нам события. В инструменте тестирования формируем 100 групп (100%), по которым распределяем всех пользователей — рандомно или по выбору. Смотрим, соответствует ли отображение текста и кнопки нужной группе. Тестируем работу всех вариантов. Если что-то будет работать неправильно, это вызовет негативную реакцию у пользователей, и работа окажется недостоверной.

-

Запуск A/B-теста и сбор данных. Основная часть метода. Важно не останавливать тест раньше, даже если на протяжении первых нескольких дней один вариант уверенно лидирует.

-

Анализ результатов. Смотрим, есть ли разница между двумя или более измеренными вариантами. Если контрольная группа не достигла поставленных целей, но вариант сработал, гипотеза была правильной.

Пример

На одном из проектов мы решали, как заинтересовать пользователя новым сервисом в приложении. Для этого проводили A/B-тестирование двух функциональностей. 50% клиентов видели текст «Получить прямо сейчас» и кнопку «Получить», а 50% — надпись «За n рублей» и кнопку «Оформить». Ссылка не менялась. Наибольший процент кликов набрал вариант с указанной суммой.

Если эксперимент не удался

В этом случае нужно запускать метод повторно с новыми вариантами и другой гипотезой. А еще неудачные A/B-тесты могут указывать на недоработки в приложении, поэтому используйте их для дальнейшей оптимизации. Однажды при введении новой вариации фичи мы проверяли ее на 10% пользователей. В итоге гипотеза не подтвердилась, но результат нас порадовал. Если бы обновление прошло без такой проверки, клиент потерял бы часть конверсий.

Вывод

А/B-тестирование — это удобный инструмент для оптимизации мобильных приложений и приближения к пользователю. Метод позволяет оценить востребованность функциональностей, экономя время на выгрузку новых релизов. А опровержение гипотезы дает почву для следующих исследований.

Процесс А/B-тестирования можно разделить на шесть этапов, большая часть из них — подготовка.

0. Создание объектов тестирования.

-

Выборка пользователей.

-

Определение продолжительности эксперимента, при которой полученные результаты будут значимы.

-

Проверка гипотезы и работы фич.

-

Запуск теста и сбор данных.

-

Анализ результатов.